![[마음의 확장 9] 알고리즘은 당신의 관심사가 아니라 플랫폼 수익을 위해 설계됐다](https://storage.ghost.io/c/21/d1/21d1f35c-c148-4b7a-a08d-0ac67a91b705/content/images/size/w960/2026/06/platform-algorithm-design-attention-sovereignty.webp)

[마음의 확장 9] 알고리즘은 당신의 관심사가 아니라 플랫폼 수익을 위해 설계됐다

이미 5년 전부터 페이스북 알고리즘은 분노 이모티콘에 좋아요 보다 다섯 배 높은 점수를 매겼다. 회사 스스로 알고 있었고, 운영진은 개선안을 기각했다. 알고리즘도 AI도 이용자의 주의가 아니라 플랫폼 수익을 위해 설계됐다. 알림을 꺼도 플랫폼은 더 정교한 방식으로 다시 끌어들인다. 개인 실천은 가치 있지만 판 자체를 바꾸지 않으면 늘 한계에 부딪힌다. 개인, 기업, 제도가 동시에 움직일 때만 주권이 실체를 갖는다. 그 교차점은 어디에 있는가.

![[마음의 확장 8] 하나에 몰빵하지 않는 역할 분담 시스템 3원칙](https://storage.ghost.io/c/21/d1/21d1f35c-c148-4b7a-a08d-0ac67a91b705/content/images/size/w960/2026/05/how-to-design-a-cognitive-offloading-role-division-system.webp)

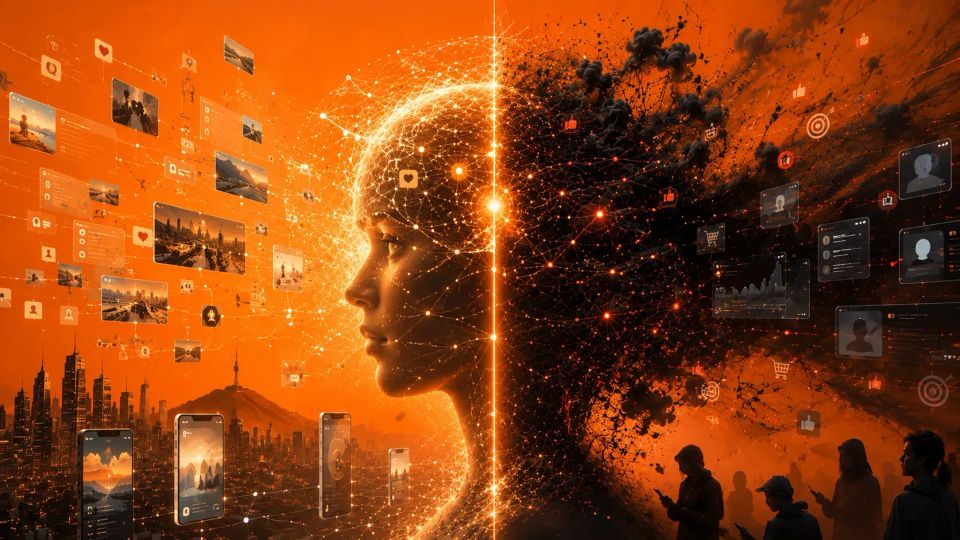

![[마음의 확장 7] 멍 때릴 틈이 사라진 시대: AI 과다 이용의 진짜 처방](https://storage.ghost.io/c/21/d1/21d1f35c-c148-4b7a-a08d-0ac67a91b705/content/images/size/w960/2026/05/attention-economy-ai-cognitive-environment-design.webp)